AI概要

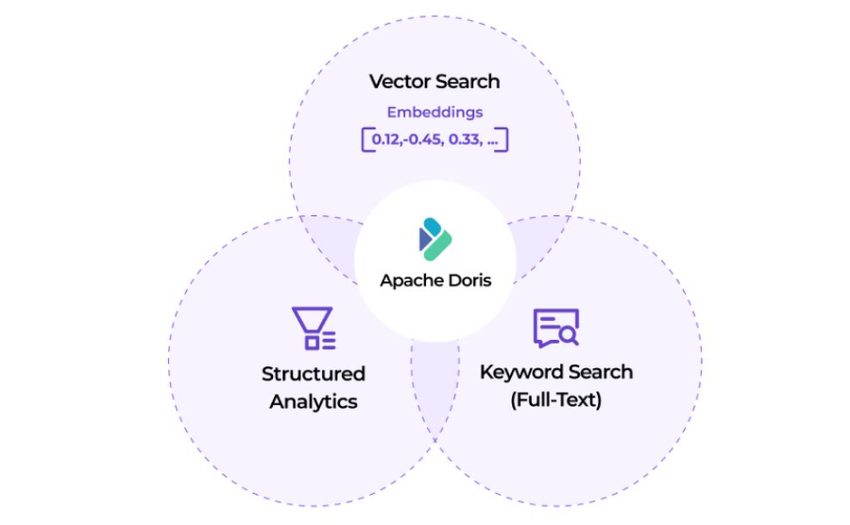

AI技術が前例のない速度で進歩を続ける中、データインフラストラクチャは現代のAIアプリケーションの基盤となっています。高性能リアルタイム分析データベースであるApache Dorisは、full-text search、vector search、AI functions、MCPベースのインテリジェントインタラクションのネイティブ統合を提供します。これらの機能が組み合わさることで、ストレージ、検索、分析にまたがる包括的なAIデータスタックを形成します。

Dorisは、hybrid searchと分析、agent facing data analysis、semantic search、RAGアプリケーション開発、大規模AIシステムの可視化など、幅広いAI駆動ワークロードに対して統一された高性能でコスト効率の良いソリューションを提供します。

エージェント Facing Analytics

AI Agent技術の台頭により、ますます多くの分析的な意思決定がAIによって自動的に完了されるようになり、データプラットフォームには究極のリアルタイム性能と高同期実行能力の提供が求められています。従来の「手動分析」とは異なり、エージェント Facing Analyticsではデータクエリと意思決定をミリ秒スケールで完了し、大量のAgentからの同期実行アクセスをサポートする必要があります。典型的なシナリオには、リアルタイム不正検出、インテリジェント広告配置、パーソナライズドレコメンデーションが含まれます。

Dorisは高性能MPPアーキテクチャにより、これらのagent-facing分析シナリオで優れた利点を実証します:

-

Real-Time Ingestion & アップデート: Agentの意思決定が最新データに基づくことを保証、最小データレイテンシ約1s

-

Blazing-Fast Analytics: 平均クエリレイテンシ100ms未満、Agentのリアルタイム意思決定要件を満たす

-

High-Concurrent Queries: 10,000+ QPSをサポート、大量のAgent同期実行クエリを容易に処理

-

Native エージェント integration: MCP Serverを通じてAI Agentとシームレスに統合、開発と統合ワークフローを簡素化

Hybrid Search and Analytics Processing

半構造化データと非構造化データは、データ分析において第一級市民になりつつあります。顧客レビュー、チャットログ、プロダクションログ、車両信号、その他のデータがビジネス意思決定プロセスに深く統合されています。従来の構造化分析ソリューションは、full-text検索とvector search機能を組み込み、semantic searchをサポートしながら、同一プラットフォーム上で多次元分析と集約統計を可能にする必要があります。例えば:

- Customer insights: レビューテキスト検索とユーザー行動分析を組み合わせ、顧客ニーズと満足度トレンドを正確に特定

- Smart manufacturing: 生産ログのfull-text search、設備画像認識、IoTメトリック分析を統合し、故障予測と品質最適化を実現

- Internet of Vehicles: 車両信号データ分析、ユーザーフィードバックテキストマイニング、運転行動vector検索を統合し、スマートコックピット体験を向上

Dorisの高性能リアルタイム分析、テキストインデックス、vectorインデックス機能に基づいて上記シナリオのAIアプリケーションを構築することで、複数の利点があります:

- 統一アーキテクチャ: 構造化分析、full-text検索、vector searchを単一プラットフォームで処理、データ移行と異種システム統合を排除

- Hybrid queryパフォーマンス: 単一SQLでvector類似性検索、キーワードフィルタリング、集約分析を同時実行し、優れたクエリ性能を実現

- 柔軟なスキーマサポート: VARIANT型が動的JSON構造をネイティブサポート、Light Schema Changeが秒レベルのフィールドとインデックス変更を可能に

- Full-stackの最適化: 転置インデックスとvectorインデックスからMPP実行エンジンまでのエンドツーエンド最適化、検索精度と分析効率のバランスを実現

レイクハウス for AI

AIモデルとアプリケーション開発には、大規模データセットからトレーニングセットの準備、特徴量エンジニアリング、データ品質評価の実行が必要です。従来のアーキテクチャでは、データレイクと分析エンジン間での頻繁なデータ移行がしばしば必要でした。Lakehouseアーキテクチャは、データレイクのオープンストレージとリアルタイム分析エンジンを深く統合し、データ準備、特徴量エンジニアリング、モデル評価の全ワークフローを統一プラットフォーム上でサポートし、データサイロを排除してAI開発イテレーションを加速します。

- Lakehouse統一アーキテクチャ: オープンTable形式(IcebergやPaimonなど)とCatalogsに基づいてオープンlakehouseを構築、分析データとAIデータを統一管理

- Real-Time Analytics Engine: Dorisがリアルタイム分析エンジンとしてインタラクティブクエリとライトウェイトETLをサポート、データ準備と特徴量エンジニアリングに最速のSQL計算機能を提供

- シームレスなデータフロー: データ移動なしでデータレイクを直接読み書き、ストレージレイヤーでの統一管理とコンピュートレイヤーでの柔軟な高速化

Dorisベースのlakehouseアーキテクチャは、AI全体のワークフローを加速します:

- 大規模データ準備: Dorisのデータ処理能力を活用してPBスケールのデータレイクからデータをフィルタリング、サンプリング、クレンジングし、高品質トレーニングデータセットを迅速構築

- リアルタイム特徴量エンジニアリング: Dorisのリアルタイム分析機能を活用してオンライン特徴量抽出、変換、集約計算を実行し、モデルトレーニングと推論にリアルタイム特徴量サービスを提供

- 品質評価: テストセットと本番データで多次元迅速分析を実行し、モデル性能とデータドリフトを継続的に監視

RAG (検索-Augmented Generation)

RAGは外部ナレッジベースから関連情報を検索して大規模モデルにコンテキストを提供し、モデルの幻覚と知識の時事性問題を効果的に対処します。vectorエンジンはRAGシステムのコアコンポーネントであり、大規模ナレッジベースから最も関連性の高いドキュメント断片の迅速な想起と、アプリケーションの応答性を確保するための高同期実行ユーザークエリリクエストのサポートが必要です。

- Enterprise knowledge: 内部ドキュメントとマニュアルに基づくインテリジェントQ&Aシステムの構築、従業員が自然言語を通じて正確な回答を迅速に取得

- インテリジェントカスタマーサービスアシスタント: プロダクトナレッジベースと履歴ケースを組み合わせ、カスタマーサービス担当者やチャットボットに正確な応答提案を提供

- インテリジェントドキュメントアシスタント: 大規模ドキュメントコレクション内の関連コンテンツを迅速に特定し、研究、執筆、意思決定プロセスを支援

DorisベースでこれらのシナリオでRAGアプリケーションを構築することで、以下の利点があります:

- 高同期実行パフォーマンス: 分散アーキテクチャが高同期実行vector検索をサポート、大規模同期実行ユーザーアクセスを容易に処理

- Hybrid検索能力: 単一SQLでvector類似性検索とキーワードフィルタリングを同時実行、セマンティック想起と完全一致のバランスを実現

- 弾力的スケーリング: クラスター拡張によりクエリ性能が線形スケール、数百万から数百億vectorへのシームレスな移行

- 統一ソリューション: vectorデータ、オリジナルドキュメント、ビジネスデータを統一管理、RAGアプリケーションのデータアーキテクチャを簡素化

AI オブザーバビリティ

AIモデルトレーニングイテレーションとアプリケーション運用は、大量のログ、メトリック、トレーシングデータを生成します。問題を正確に特定し性能を継続的に最適化するため、可視化システムはAIインフラストラクチャの重要なコンポーネントとなっています。ビジネス規模の拡大に伴い、可視化プラットフォームはPBスケールデータの高スループット書き込み、ミリ秒レベルの検索応答、コスト制御など複数の課題に直面しています。典型的な使用例には以下が含まれます:

- モデルトレーニング監視: トレーニングメトリックとリソース消費をリアルタイム追跡、トレーニング異常と性能ボトルネックを迅速特定

- 推論サービストレーシング: 各推論リクエストの完全トレースを記録、レイテンシ源とエラーパターンを分析

- AI アプリケーションログ分析: 大量のアプリケーションログのfull-text検索と集約分析、トラブルシューティングと行動洞察をサポート

DorisでAI オブザーバビリティを構築することで、以下の利点があります:

- 究極の性能: PB/day(10GB/s)の持続書き込みをサポート、転置インデックスがログ検索を加速し秒レベルの応答を実現

- コスト最適化: 5:1から10:1の圧縮率、ストレージコストを50%-80%削減、コールドデータの低コストストレージをサポート

- 柔軟なスキーマ: Light Schema Changeが秒レベルのフィールド変更を可能に、VARIANT型が動的JSON構造をネイティブサポート

- エコシステムフレンドリー: OpenTelemetryとELKエコシステムと互換、Grafana/Kibana可視化ツールとの統合をサポート

Semantic Search

Semantic searchはベクトル化技術を通じてテキストの深い意味を捉えます。クエリ用語がドキュメントの文言と異なっていても、意味的に関連するコンテンツを検索できます。これは多言語検索、同義語認識、意図理解などのシナリオに重要で、検索再現率とユーザー体験を大幅に向上させます。典型的な使用例には以下が含まれます:

- エンタープライズドキュメント検索: 従業員が自然言語で問題を記述し、システムが意図を理解して大量のドキュメントから意味的に関連するポリシー、手順、知識を想起

- Eコマース商品検索: ユーザーが「夏に適した通気性の良い靴」と入力し、システムがニーズを理解して単純なキーワードマッチングではなく関連商品を想起

- コンテンツ推奨: 記事や動画の意味的類似性に基づくインテリジェント推奨、異なる文言で潜在的に興味のあるコンテンツを発見

Dorisベースでsemantic searchアプリケーションを構築することで、以下の利点があります:

- 高性能vector検索: HNSWとIVFアルゴリズムをサポート、億スケールvectorに対して秒未満の応答、大規模semantic search要件を容易に処理

- 強化されたhybrid検索: 単一SQLでsemantic searchとキーワードフィルタリングを統合、必要な語彙ヒットを確保しながら意味的に関連するコンテンツを想起

- マルチモーダル拡張: テキストsemantic searchだけでなく、画像や音声などマルチモーダルコンテンツのセマンティック検索にも拡張可能

- 柔軟な量子化最適化: SQ/PQ量子化技術により、検索精度を維持しながらストレージと計算コストを大幅削減