AutoMQ Load

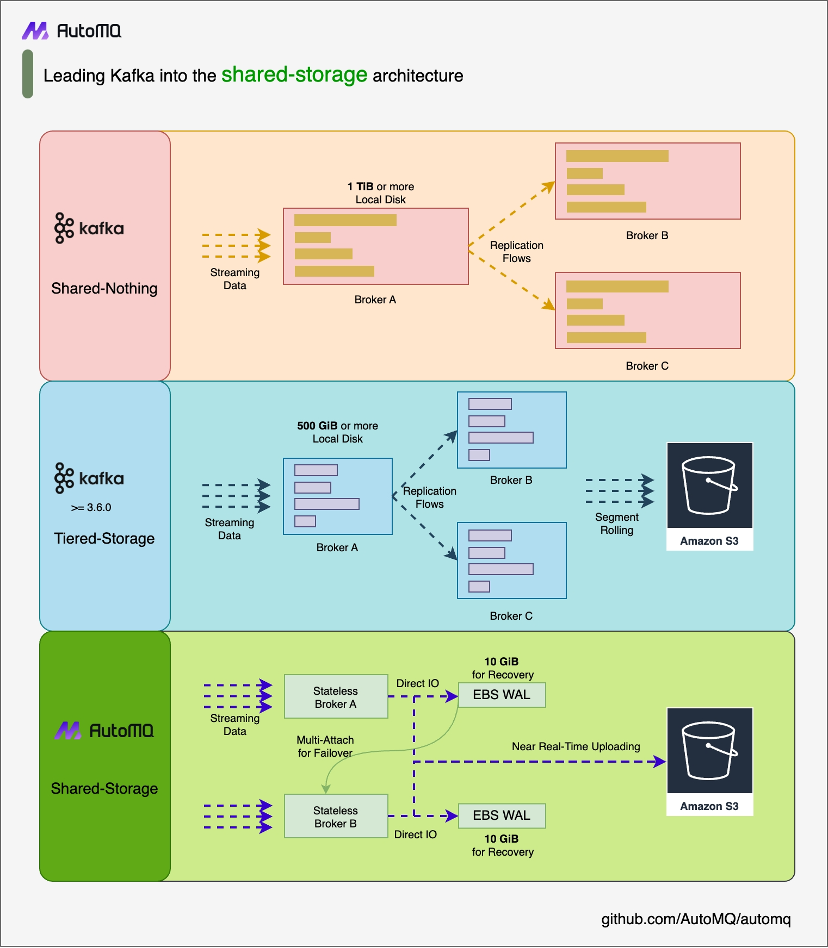

AutoMQは、ストレージをS3のようなオブジェクトストレージに分離することでKafkaをクラウドネイティブ化したフォークです。Apache Kafka®との100%互換性を保ちながら、最大10倍のコスト効率性と100倍の弾力性をユーザーに提供します。革新的な共有ストレージアーキテクチャにより、パーティションの再配置を数秒で行う機能、自動バランシング、数秒での自動スケーリングを実現し、同時に高いスループットと低レイテンシを確保しています。

この記事では、Apache Doris Routine Loadを使用してAutoMQからDorisにデータをインポートする方法について説明します。Routine Loadの詳細については、Routine Loadドキュメントをご参照ください。

環境準備

Apache Dorisとテストデータの準備

動作するApache Dorisクラスターがすでにセットアップされていることを確認してください。デモンストレーション目的で、Quick Startedドキュメントに従ってLinux上にテスト用のApache Doris環境をデプロイしました。 データベースとテストテーブルを作成:

create database automq_db;

CREATE TABLE automq_db.users (

id bigint NOT NULL,

name string NOT NULL,

timestamp string NULL,

status string NULL

) DISTRIBUTED BY hash (id) PROPERTIES ('replication_num' = '1');

Kafka Command Line Toolsの準備

AutoMQ Releasesから最新のTGZパッケージをダウンロードして展開してください。展開ディレクトリを$AUTOMQ_HOMEとすると、この記事では$AUTOMQ_HOME/bin以下のスクリプトを使用してトピックを作成し、テストデータを生成します。

AutoMQとテストデータの準備

AutoMQの公式デプロイメントドキュメントを参照して機能的なクラスターをデプロイし、AutoMQとApache Doris間のネットワーク接続を確保してください。 以下の手順に従って、AutoMQ内にexample_topicという名前のトピックを素早く作成し、テストJSONデータを書き込みます。

トピックの作成

AutoMQ内のApache Kafka®コマンドラインツールを使用してトピックを作成します。Kafka環境にアクセス可能で、Kafkaサービスが実行中であることを確認してください。以下はトピックを作成するコマンドの例です:

$AUTOMQ_HOME/bin/kafka-topics.sh --create --topic exampleto_topic --bootstrap-server 127.0.0.1:9092 --partitions 1 --replication-factor 1

ヒント: コマンドを実行する際は、

topicとbootstarp-serverを実際のAutoMQ Bootstrap Serverアドレスに置き換えてください。

topicを作成した後、以下のコマンドを使用してtopicが正常に作成されたことを確認できます。

$AUTOMQ_HOME/bin/kafka-topics.sh --describe example_topic --bootstrap-server 127.0.0.1:9092

テストデータの生成

前述のテーブルに対応するJSON形式のテストデータエントリを作成します。

{

"id": 1,

"name": "testuser",

"timestamp": "2023-11-10T12:00:00",

"status": "active"

}

テストデータの書き込み

Kafkaのコマンドラインツールまたはプログラミングアプローチを使用して、example_topicという名前のトピックにテストデータを書き込みます。以下は、コマンドラインツールを使用した例です:

echo '{"id": 1, "name": "testuser", "timestamp": "2023-11-10T12:00:00", "status": "active"}' | sh kafka-console-producer.sh --broker-list 127.0.0.1:9092 --topic example_topic

トピックに書き込まれたデータを表示するには、次のコマンドを使用します:

sh $AUTOMQ_HOME/bin/kafka-console-consumer.sh --bootstrap-server 127.0.0.1:9092 --topic example_topic --from-beginning

Tips: コマンドを実行する際は、

topicとbootstarp-serverを実際の AutoMQ Bootstrap Server アドレスに置き換えてください。

Routine Load インポートジョブの作成

Apache Doris コマンドラインで、AutoMQ Kafka topic からデータを継続的にインポートするために JSON データを受け入れる Routine Load ジョブを作成します。Routine Load の詳細なパラメータ情報については、[Doris Routine Load] を参照してください。

CREATE ROUTINE LOAD automq_example_load ON users

COLUMNS(id, name, timestamp, status)

PROPERTIES

(

"format" = "json",

"jsonpaths" = "[\"$.id\",\"$.name\",\"$.timestamp\",\"$.status\"]"

)

FROM KAFKA

(

"kafka_broker_list" = "127.0.0.1:9092",

"kafka_topic" = "example_topic",

"property.kafka_default_offsets" = "OFFSET_BEGINNING"

);

ヒント: コマンドを実行する際は、kafka_broker_listを実際のAutoMQ Bootstrap Serverアドレスに置き換える必要があります。

データインポートの検証

まず、Routine Loadインポートジョブのステータスを確認して、タスクが実行中であることを確認します。

show routine load\G;

その後、Apache Dorisデータベースの関連テーブルにクエリを実行すると、データが正常にインポートされていることが確認できます。

select * from users;

+------+--------------+---------------------+--------+

| id | name | timestamp | status |

+------+--------------+---------------------+--------+

| 1 | testuser | 2023-11-10T12:00:00 | active |

| 2 | testuser | 2023-11-10T12:00:00 | active |

+------+--------------+---------------------+--------+

2 rows in set (0.01 sec)